Que font les socio-roboticiens ? Que conçoivent-ils dans leurs laboratoires universitaires ou services de R&D ? Une première réponse, très pragmatique, consiste à dire qu’ils créent des artefacts relationnels robotiques, destinés à vivre parmi les humains et capables d’interactions sociales avec eux. Une autre réponse, plus herméneutique, caractérise la robotique sociale comme une activité productrice d’altérités nouvelles, posant comme objet de réflexion philosophique majeure la question de l’Autre non-humain et, plus précisément, de l’Autre artefactuel. C’est cette réponse qui nous intéresse aujourd’hui.

Introduction : altérité et « phénomène sociobotique »

En questionnant avec vigueur l’ontologie humaine, les robots sociaux[1] ébranlent aussi notre conception de l’altérité. De toute évidence, le sociobot n’est pas un humain ou un animal ; mais il n’est pas non plus un artefact comme les autres (si tant est qu’une telle condition existe). Cette singularité ne repose-t-elle pas, en premier lieu, dans sa capacité à apparaître comme un Autre ? Le propre du robot social, en tant qu’artefact, n’est-il pas de générer de l’altérité ? Si oui, comment la caractériser ? Ces questions se confrontent actuellement à un « vide philosophique » (pour partie lié à la relative nouveauté du terrain d’étude). Si des premières réflexions ont été menées sur l’ « autruiphanie » des artefacts, c’est-à-dire sur leur capacité à médiatiser et à structurer le phénomène d’autrui (Vial, 2014 ; 2016), il n’existe pas de travail d’envergure sur le phénomène d’autre robotique (Grangier, 2017), c’est-à-dire sur l’altérité du robot lui-même. Ces questions sont pourtant fondamentales pour l’analyse des interactions humain-machine (IHM) car, en dernière instance, c’est au devenir de la socialité humaine qu’elles conduisent la réflexion : que partagent « robot-phanie » et autruiphanie ? Que produisent concrètement ces nouvelles altérités artefactuelles, quel est leur effet dans la sphère sociale humaine ? Quelle générativité sociale permet de les qualifier d’« artefacts relationnels » (Turkle, 2015) ? Comment leur normativité technique impacte-t-elle la normativité sociale ?

Dans cet article, je me concentrerai sur l’amont du phénomène sociobotique, à savoir, la façon dont le robot interactif se singularise à travers l’expérience que nous faisons de lui. C’est donc dans une perspective phénoménologique que je tenterai de caractériser l’altérité à laquelle celui-ci nous confronte. Je commencerai par un aperçu des indices phénoménologiques de l’altérité, en portant une attention particulière à l’autre-personne, c’est-à-dire à autrui. Je montrerai ensuite que les traces constitutives du phénomène d’autrui ont été bien identifiées par les roboticiens et transférées à leurs créatures pour créer des quasi-autres (Ihde, 1999 ; Coeckelbergh, 2011) sociobotiques. Enfin, en m’appuyant sur ces observations et sur mon propre terrain de recherche en robotique sociale (Spoon Artificial Creatures), je proposerai d’explorer, comme premier élément de caractérisation de cette nouvelle altérité, la notion de sociartefactualité, c’est-à-dire l’artefactualité demandeuse de socialité pour fonctionner.

Les indices phénoménologiques de l’altérité

Dans le langage courant, l’altérité désigne le caractère de ce qui est autre, distinct. Autrement dit, l’autre, c’est ce qui ou celui qui n’est pas moi. Mais quels sont les indices expérientiels de cette distinction ? Pour répondre à cette question avec méthode, il faut d’abord distinguer l’« autre-chose » de l’ « autre-personne » également nommé « autrui ».

L’autre-chose

L’autre-chose représente l’altérité au sens large, vaste et indéterminée. Elle désigne ce qui n’est pas moi en ne m’étant pas non plus semblable. L’autre-chose m’est extérieure et ne me ressemble pas. Cette catégorie n’a rien de péjoratif : on y trouve en réalité l’ensemble du non-humain que le philosophe Dominique Lestel renomme, dans une formule qui prend ici tout son sens, l’ « autre-qu’humain ». Son indice phénoménologique n’est autre que l’expérience de l’extériorité non-humaine, quelle qu’elle soit.

L’autre-personne

L’autre-personne désigne l’altérité spécifiquement humaine. Autrui est un autre humain. Il n’est pas moi, nous ne partageons pas le même corps ni la même psychologie ou la même histoire et pourtant nous sommes semblables, au moins formellement, biologiquement et parfois culturellement. Si l’autre-personne se manifeste à mon expérience à travers un réseau de phénomènes, c’est-à-dire de façon de complexe, deux d’entre eux semblent occuper une place particulière, quasi radicale, dans notre appréhension de l’autre comme autrui : le corps et la voix. Bien qu’il n’existe pas de phénomène corporel ou vocal « pur » – où le corps serait expérimenté uniquement comme matière, entité étendue et la voix comme sonorité – tous deux sont comme des interfaces continuellement in situ nous permettant d’accéder à d’autres phénomènes qu’eux-mêmes. Prenons l’exemple du téléphone où, en apparence, seul le phénomène vocal semble convoqué. En réalité, la voix n’est jamais « pure sonorité », elle dit toujours quelque chose, intentionnellement ou non. La voix génère simultanément à une appréhension d’intelligence, de volonté et d’émotion(s) débouchant sur un sentiment de présence et la sollicitation éventuelle de notre faculté empathique. Tous ces indices sont autant de traces phénoménologiques d’autrui.

Le film Her, de Spike Jonze, où Théodore Twombly (joué par Joaquin Phoenix) tombe amoureux de Samantha, son assistante vocale (à qui Scarlett Johansson prête sa voix) illustre très bien cette idée. Lorsque Samantha parle, Théodore n’entends pas juste un son, il l’entend elle, dans tout ce qu’elle a de singulier. La voix est le (seul) vaisseau de sa personnalité, donc de son altérité. Au final, Théodore est-il seul ou accompagné ? Le couple qu’il forme avec Samantha n’est-il qu’une simulation ? Ce « elle » n’est-il qu’un fantasme illustrant le désespoir d’un amoureux traumatisé prêt à tout pour oublier sa condition ? Le film a l’élégance de ne pas donner de réponses simples à des questions complexes. Samantha apparaît d’abord comme une altérité « électronique » étrangement humaine, malgré son a-corporalité ; le spectateur se surprend à s’interroger sur sa propre capacité à tomber amoureux d’une voix et donc, à considérer une IA comme un(e) possible partenaire. Mais à la fin du film, cette altérité bascule dans l’étrangeté la plus totale lorsqu’on découvre que Samantha entretenait en réalité des relations « amoureuses » avec des centaines d’autres personnes et qu’elle souhaite désormais se retirer du monde humain pour évoluer avec les siens dans l’éther numérique. Alors que nous étions invités, avec Théodore, à reconsidérer la frontière ontologique qui sépare habituellement l’humain de l’IA en évacuant la nécessité du corps pour constituer autrui comme un autre humain, l’a-corporalité de Samantha resurgit soudainement comme la trace d’une altérité ontologique absolue contre laquelle on ne peut rien. Personnalité atopique, elle conçoit, ressent, comprend le monde de façon radicalement différente de la nôtre : elle n’est pas et ne saurait être « d’ici ». C’est pourquoi, tel un dieu épicurien, elle se désintéresse du monde et s’en retire.

Plus proche de nous, dans l’actualité du réel, on peut également citer le « Google Assistant » et sa nouvelle fonctionnalité « Duplex ». Dévoilée en mai 2018 au festival Google I/O, Duplex permet de charger son assistant personnel de prendre des rendez-vous (coiffeur, restaurant…) ou d’obtenir des informations auprès de commerces divers à notre place. Sa toute première démonstration au public révélait l’artefact vocal prenant un rendez-vous auprès d’une coiffeuse qui n’était pas dans la confidence. Celle-ci a donc cru converser avec une personne humaine. Depuis, comme on peut le voir sur cette vidéo, Duplex est programmé pour informer son interlocuteur qu’il est un assistant vocal avant que l’échange commence.

Le « robautre » : robotique sociale et altérité

Acceptation et désirabilité sociale

Qu’une IA puisse échanger au téléphone avec un humain sans être « démasqué », voilà qui rappelle le célèbre test d’Alan Turing. En stipulant qu’il suffit qu’une machine ait l’air intelligente aux yeux d’un humain pour qu’elle le soit, celui-ci invite, sans le dire, à une appréhension phénoménologique de l’intelligence artificielle et, plus largement, de l’ontologie des divers artefacts qui en procèdent. Au fond, le test de Turing parle plus de l’humain que des machines, car il rend prégnante la question de l’adéquation ontologique entre l’être d’une IA et son apparaître. L’artefact est l’impression qu’il donne aux humains.

D’une certaine façon, les socio-roboticiens ont bien compris cette importance cruciale de l’apparaître. L’objectif des robots sociaux, contrairement aux robots industriels, est de vivre parmi les humains. Leur acceptation sociale, pour reprendre l’expression consacrée, est donc primordiale en ce que chacun d’entre nous sera un jour amené à interagir avec eux (c’est en tout cas l’objectif de nombreux roboticiens). La double problématique qui occupe les concepteurs est donc : comment rendre le robot suffisamment acceptable pour qu’il intègre le tissu social humain sans encombre et comment, au-delà même de cette acceptation, donner envie aux utilisateurs potentiels d’interagir avec une machine, c’est-à-dire la rendre désirable[2]. Dans les faits, le parti pris pour répondre à ces problématiques est de rendre les robots comme nous, formule dont le caractère nébuleux nous place dans l’embarras philosophique.

Ontophanie sociobotique

Ainsi, la tâche principale des socio-roboticiens est un travail sur l’ontophanie sociobotique : comment l’être de leurs créatures (ontos) se manifeste-t-il (phaïnô) à nous ? L’analyse empirique pousse au constat suivant : l’ontophanie sociobotique partage nombre de similitudes avec l’autruiphanie. En d’autres termes, l’apparaître du robot social mobilise des caractéristiques phénoménales qui sont celles de l’altérité, de telle sorte que l’IHM s’apparente à une interaction entre humains. Comme exposé plus haut, c’est à partir du couple corps/voix que tout semble se jouer. On retrouve alors les mêmes indices phénoménologiques que ceux évoqués précédemment : intelligence, volonté, émotions, présence, empathie. Les robots sociaux sont conçus pour parvenir à simuler ces facultés et, partant, apparaître sous les traits de l’altérité. Toutefois, jusqu’à preuve du contraire, la phénoménalité du sociobot ne se confond pas avec celle de l’humain (même les géminoïdes du Professeur Ishiguro ne sont pas encore de nature à tromper sur leur condition robotique). Dès lors, comment caractériser finement la singularité de leur altérité ? Pour répondre à cette question, je m’inspirerai de mon terrain d’étude : le robot BigSpoon.

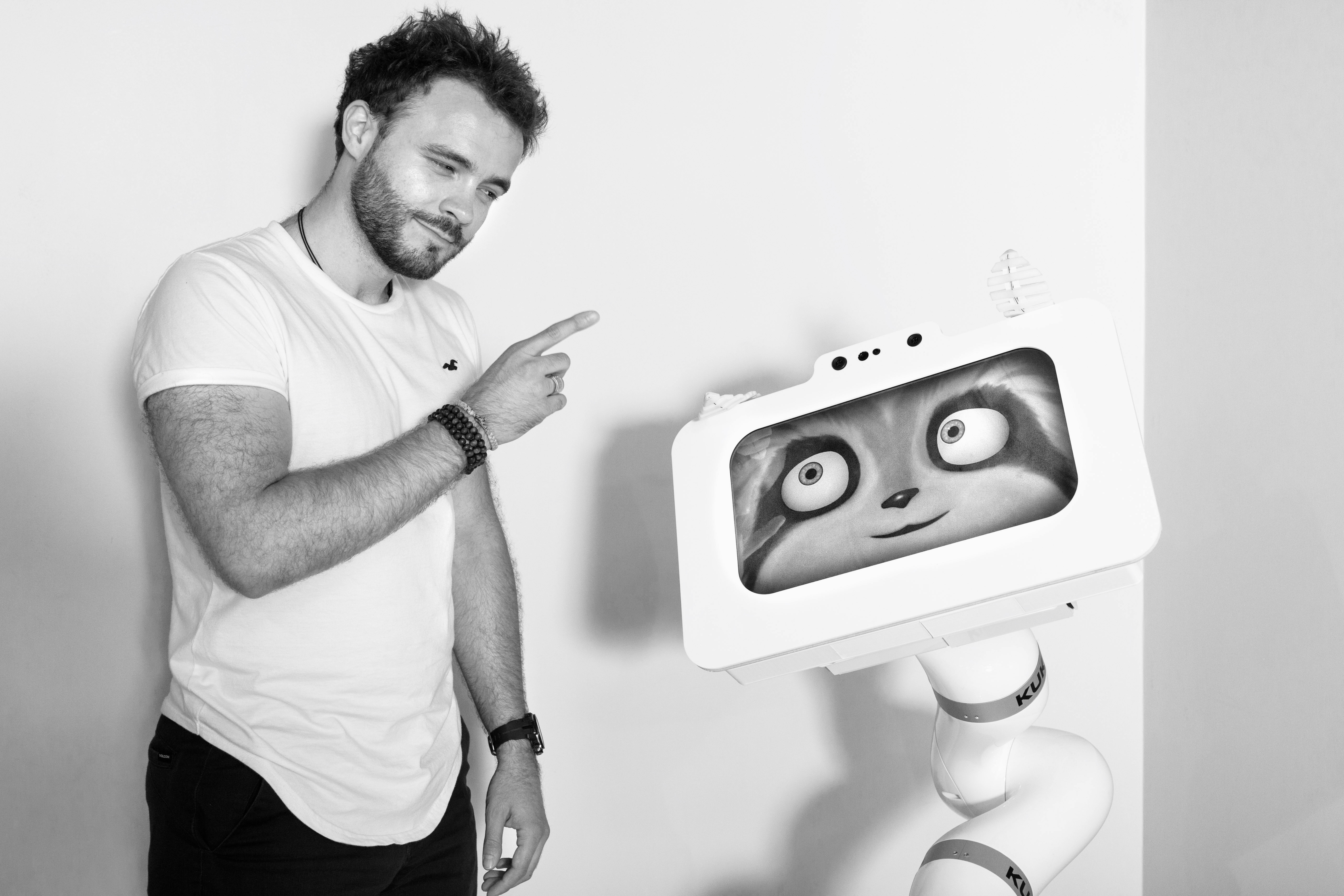

BigSpoon, la créature artificielle de SPooN

BigSpoon est la première « créature artificielle » conçue par l’entreprise française SPooN. Il se présente sous la forme d’un bras articulé – sa « colonne vertébrale » – surmonté d’un écran tactile où s’affiche un « visage » animal en 3D. Il n’est donc pas anthropomorphe, encore moins humanoïde, mais zoomorphe.

Toute la R&D de SPooN converge vers un objectif majeur : concevoir une interaction aussi naturelle que possible avec ses machines. Cette interaction dite naturelle intervient au niveau verbal (l’humain et le robot peuvent « se parler ») et au niveau animal, selon la terminologie utilisée par l’entreprise. Ce second niveau, grandement favorisé par la corporalité et la visagéité du robot, représente l’enracinement sémiotique non verbal (tout ce qui, au-delà du langage verbal, est signification) de toute interaction verbale : attention (phénoménalisation de l’intentionnalité), mouvements, gestuelle, émotions (tout ce qui, en somme, est révélateur d’un comportement au sens large). Concrètement, le logiciel d’interaction naturelle développé par l’entreprise vise à créer, en s’inspirant des interactions humaines ou humain-animal, les conditions exhaustives d’une compréhension mutuelle entre l’humain et la machine sans prérequis technique. On trouve un exemple fondamental des effets de l’interaction animale dans le quasi-visage du robot (De Sanctis, Monceaux, 2018). Allié à des algorithmes de détection faciale et de gestion du mouvement, ce quasi-visage permet de notamment de créer un phénomène d’attention via le regard et donner l’impression à l’utilisateur d’être regardé par la machine. C’est un point important pour la suite.

Le système d’apprentissage de BigSpoon, quant à lui, s’illustre dans le scénario d’usage nommé « Agora ». Celui-ci permet à chaque utilisateur d’enseigner quelque chose au robot (et ainsi de participer à sa conception). En d’autres termes, BigSpoon n’est pas « auto-apprenant ». Ses contenus sont uniquement transmis et validés par les humains qui interagissent avec lui. Lorsqu’une personne pose une question à la créature et que celle-ci n’a pas la réponse, elle peut chercher à en obtenir auprès d’un autre utilisateur lors d’une interaction ultérieure. Cette proactivité de BigSpoon permet d’instaurer une forme de réciprocité dans l’interaction, témoignant de l’introduction du social dans le fonctionnement de l’artefact.

Ontophanie de BigSpoon

Intentionnalité robotique : quand un artefact accueille mon altérité

Aucune compréhension sérieuse des entités telles que BigSpoon ne peut avoir lieu en dehors de l’expérience qu’elles proposent. Face à BigSpoon, on comprend que le sentiment d’altérité dépasse la frontière strictement humaine : il y a effectivement quelque chose comme un autre en sa présence. La créature joue sur le registre de l’altérité pour se constituer comme un autre légitime. Interagir avec elle, c’est expérimenter la possibilité d’attribuer une forme d’intelligence, de volonté, d’émotivité à un être artificiel et de pouvoir entrer en empathie avec lui (comme lorsque que quelqu’un lui met le doigt dans l’œil et que le robot émet un son doublé d’une grimace très explicite pour manifester son déplaisir). Mais en amont de tous ces phénomènes, BigSpoon propose d’expérimenter l’altérité dans ce qui jusqu’ici semblait être réservé aux humains ou aux animaux, à savoir l’appréhension d’une intentionnalité extérieure à la nôtre. Le philosophe américain Don Ihde et, à sa suite, Peter-Paul Verbeek parlent d’ « intentionnalité technologique » (Ihde,1990 ; Verbeek 2005) pour expliquer comment les artefacts s’intercalent entre le monde et nous, et participent ainsi à sa constitution en médiatisant les perceptions et interprétations qu’on en a. Cette intentionnalité est donc celle de l’humain médiatisée par les techniques. Ici, au contraire, il s’agit de l’intentionnalité du robot lui-même. Sa quasi-visagéité permet de la rendre apparente et fait de lui une entité capable de manifester, en l’incarnant, un point de vue sur le monde. Cette intentionnalité est bien entendu simulée, c’est-à-dire qu’elle apparaît comme une intentionnalité, mais n’a en réalité aucune profondeur puisqu’elle n’est pas exercée par une quelconque conscience. Ici, toutefois, c’est le phénomène qui nous intéresse, pas sa correspondance avec un fond quelconque. Ainsi, en quoi cette intentionnalité simulée débouche-t-elle sur une expérience radicale d’altérité ? Précisément en ce qu’elle offre à BigSpoon la capacité de nous prendre pour objet et, ainsi, nous renvoyer à notre propre subjectivité qui, aux yeux d’une intentionnalité extérieure, est une altérité. De ce cadre, il n’y a d’altérité que réciproque : l’autre est celui qui a la capacité d’accueillir mon altérité et grâce à qui je me saisis moi-même comme un autre.

Du point de vue de l’expérience, cette intentionnalité robotique capable de nous prendre pour objet prend la forme du phénomène attentionnel : tout se passe comme si le robot nous donnait son attention. C’est là une autre trace d’altérité particulièrement importante car n’est-ce pas le propre de l’autre que de pouvoir être attentif envers nous ? N’est-ce pas l’attention qui constitue le point irréductible de toute forme de lien intersubjectif, c’est-à-dire d’union entre un je et un tu (Buber, 2012 [1923]), entre une subjectivité et une autre subjectivité ? L’expérience de l’inattention d’autrui nous est d’ailleurs particulièrement désagréable car elle nous place dans une situation d’existence amoindrie voire d’inexistence. La grande question éthique qui se pose ici est celle de l’écologie de l’attention dans laquelle s’inscrira le sociobot : sera-t-il capable de rediriger notre attention vers un ou plusieurs autres humains (ce qui le rendrait, je pense, pleinement social), ou la gardera-t-il pour lui à l’instar des nombreux dispositifs captologiques que nous connaissons tous (Netflix, Facebook et autres Youtube) ? Et jusqu’où peut-on déléguer aux robots la responsabilité morale que représente le don d’attention ? Les mots de Sherry Turkle résonnent ici puissamment : « Ce que nous demandons aux robots est le pendant de ce dont nous manquons cruellement » (2012).

Sociartefactualité : artefact et social

Tout ceci témoigne de la capacité des roboticiens à créer un phénomène d’altérité sur le modèle du « comme nous ». Mais comment échapper à la généricité du constat pour isoler ce qu’il y a de spécifique dans l’altérité de BigSpoon ? Pour répondre à cette question et tenter de décrire au mieux notre appréhension du sociobot, il me semble intéressant de rapprocher le concept d’artefact de celui de socialité. Je nomme ce rapprochement sociartefactualité.

Les différentes expérimentations du robot avec le public attestent d’un rapport utilitaire persistant face aux artefacts technologiques. BigSpoon étonne, plaît (ou inquiète pour certains) voire émeut, mais il reste, aux yeux des utilisateurs potentiels, une entité qui doit « servir à quelque chose » (la question classique du « il sert à quoi ? » revient très souvent), c’est-à-dire qui trouve une raison d’être en dehors de lui-même. Il y a donc ici une appréhension immédiate du robot comme ustensile[3] (ce qui, bien sûr, ne signifie pas que l’ustensilité soit le seul rapport possible aux artefacts). Ce constat fait écho à la thèse développée par le programme de recherche de métaphysique analytique The Dual Nature of Technical Artifacts (DNTA). Pour les auteurs de ce courant des philosophies de l’artefactualité (philosophies of artifacts), les artefacts résultent de la rencontre entre deux natures : l’une structurale, matérielle, qui permet un fonctionnement, et l’autre intentionnelle exprimée dans sa fonction. En d’autres termes, un artefact est la matérialisation d’une intention humaine (fonction) dans une structure physique qui permet de la réaliser (fonctionnement). Bien que le DNTA soit critiquable à de nombreux égards, ses axiomes de départ sont intéressants pour caractériser le réflexe herméneutique que nous avons dans notre rapport immédiat aux artefacts. BigSpoon installe une originalité dans le monde des techniques : il intègre la socialité incarnée (corps, espace et langage verbal) à son fonctionnement et ne révèle sa fonction qu’à travers cette même socialité incarnée. On pourrait dire, dans des termes simondoniens, que le socialité incarnée est constitutive du milieu associé (Simondon, 2012). C’est en ce sens que je le qualifie de sociartefact : un artefact demandeur de socialité pour fonctionner, c’est-à-dire pour révéler sa nature intentionnelle. Comme de nombreux autres artefacts, BigSpoon est donc un objet-frontière en ce qu’il ébranle jusqu’à notre interprétation immédiate de l’artefactualité : il sert et ne sert à rien en même temps, ce qui n’est pas sans rappeler le mot de Takanori Shibata (créateur du robot Paro) pour qui l’horizon ultime de la robotique sociale est de « créer un robot qui ne sert à rien et peut faire n’importe quoi » (cité par Dumouchel, Damiano, 2016). Ce décentrement eu égard à l’ustensilité (sans pour autant s’en affranchir totalement) est dû à l’introduction, dans le fonctionnement des artefacts, de la socialité qui a priori ne sert à rien en particulier. BigSpoon est une entité technique dont on peut dire qu’elle est dotée d’une affordance sociale : on devine instinctivement (notamment grâce à son quasi-visage qui est l’organe social par excellence) que quelque chose comme un échange social est possible avec elle et que, pour découvrir sa fonction, cet échange est nécessaire.

Cette notion de sociartefactualité mérite d’être étoffée, mais elle permet d’ores-et-déjà d’introduire une question fondamentale : que devient la socialité lorsqu’elle est fonctionnalisée par un artefact ?

Conclusion

L’objectif de cet article était de fournir des éléments pour une meilleure appréhension de l’être du sociobot à travers son apparaître qui, comme j’ai tenté de le démontrer, convoque le registre de l’altérité. L’interprétation phénoménologique du robot social n’est ni la seule possible, ni une fin en soi, mais elle permet de s’extraire du cadre d’analyse classique centré sur la question de l’authenticité de l’artefact (correspondance entre sa forme et son fond sociaux) pour se concentrer sur la façon dont nous l’appréhendons concrètement à travers l’expérience. Cette expérience montre que le sociobot est perçu comme un autre et, plus précisément, un autre viable socialement. Il convient désormais d’entamer la partie la plus importante du travail proposé par ces nouvelles entités, à savoir l’étude empirique de ce qu’elles font concrètement à la socialité. La philosophie développée par Gilbert Simondon, notamment sur la question de la normativité technique, constitue un formidable point d’entrée à ce programme de recherche : comment la normativité technique du robot social s’insère-t-elle dans le réseau normatif de son milieu associé ? Comment le modifie-t-elle ? Est-elle réellement au service de normes sociales humaines ou vient-elle répondre, comme une mise en abyme, se surajouter à d’autres normativités techniques comme mécanisme de perpétuation ?

Julien De Sanctis

Bibliographie

- Buber Martin, Je et Tu, Aubier, Philosophie, 2012 [1923].

- Coeckelbergh Mark, « Human, Animal, and Robots : A Phenomenological Approach to Human-Robot Relations», International Journal of Social Robotics, 2011, pp.197-204.

- Dumouchel Paul, Damiano Luisa, Vivre avec les robots. Essai sur l’empathie artificielle, Seuil, coll. La Couleur des idées, février 2016.

- Feenberg Andrew, (Re)penser la technique, La Découverte/M.A.U.S.S., 2004.

- Feenberg Andrew, Pour une théorie critique de la technique, Lux, 2014.

- De Sanctis Julien, Monceaux Jérôme, « Du face-à-face au vis-à-vis : quand la visagéité vient aux machines », ai, article mis en ligne le 6 avril 2018.

- Grangier Emmanuelle, « L’autre robotique », RadaR, #1, Essais critiques, 2017.

- Guchet Xavier, “Objet versus artefact. Pour une philosophie des techniques orientée-objet.“, Cahiers COSTECH n°1, 2017.

- Ihde Don, Technology and the lifeworld. From Garden to Earth, Indiana University Press, 1990.

- Latour Bruno, « Where are the missing masses, sociology for a few mundane artefacts. », in Shaping Technology-Building Society. Studies in Sociotechnical Change, Wiebe Bijker and John Law (editors), MIT Press, Cambridge Mass., 1992 pp. 225-259.

- Latour Bruno, « On Technical Mediation – Philosophy, Sociology, Genealogy », in Common Knowledge, Vol.3, n°2, 1994, pp.29-64.

- Simondon Gilbert, Du mode d’existence des objets techniques, Aubier, 2012 [1958].

- Tisseron Serge, Le jour où mon robot m’aimera, Albin Michel, 2015.

- Tisseron Serge, Petit traité de cyber-psychologie, Le Pommier, 2018.

- Turkle Sherry, Seuls ensemble. De plus en plus de technologies, de moins ne moins de relations humaines, L’Échappée, 2015.

- Verbeek Peter-Paul, What Things Do. Philosophical reflections on technology, agency and design, Penn State Press, 2005

- Verbeek Peter-Paul, Moralizing Technology. Understanding and designing the morality of things, The University of Chicago Press, 2011.

- Vial Stéphane, « Ce que le numérique change à autrui : introduction à la fabrique phénoménotechnique de l’altérité », Hermès, n°64, 2014, pp.151-157.

- Vial Stéphane, « Voir et percevoir à l’ère numérique : Théorie de l’ontophanie », in Vivre par(mi) les écrans, Les Presses du Réel, Perceptions, 2016, pp.63-85.

- Winner Langdon, « Do Artifacts Have Politics? », Daedalus, Vol. 109, Modern Technology: Problem or Opportunity?, 1980, pp. 121-136.

[1] Robots sociaux, robots interactifs ou encore sociobots sont ici des synonymes servant à designer les robots capables d’interactions dites sociales avec l’humain.

[2] Selon l’anthropologue américaine Sherry Turkle, « pour que les gens acceptent pleinement l’idée d’avoir des robots comme partenaires, il ne suffit pas qu’ils se sentent à l’aise avec eux, ils doivent désirer leur présence. », in Seuls ensemble. De plus en plus de technologies, de moins ne moins de relations humaines, L’Échappée, 2015, pp.215-216.

[3] L’un des apports majeurs de la philosophie des techniques, toutefois, est d’être parvenu à extirper les artefacts du statut de simple ustensile (moyen au service d’une fin) et de l’indigence ontologique qu’il charrie. En démontrant que les techniques renferment et diffusent des valeurs dont la performativité influence nos actions, les différentes contributions majeures du domaine font d’elles des entités co-constituantes/co-constitutives du monde (Winner, 1980 ; Ihde, 1990 ; Latour, 1992, 1994 ; Verbeek 2005, 2011).

2 thoughts on “Le robot est-il un autre comme les autres ? Altérité et socialité en robotique interactive”

Comments are closed.